支撐億級用戶“刷手機”,F(xiàn)eed流背后的新技術(shù)裝備有多牛?

當(dāng)我們每天無數(shù)次打開手機,手指輕輕一滑,信息便如瀑布般涌出——新聞、短視頻、朋友圈動態(tài)……這種被稱為“Feed流”的體驗已融入日常生活。支撐億級用戶實時、個性化“刷”信息的背后,是一整套復(fù)雜而強大的信息處理和存儲技術(shù)支持體系。本文將深入解析這些鮮為人知卻至關(guān)重要的“新技術(shù)裝備”究竟有多牛。

一、海量數(shù)據(jù)實時處理的“超級引擎”:流計算與批處理的融合

面對每秒鐘數(shù)百萬甚至上千萬條的信息發(fā)布、互動、點擊行為,傳統(tǒng)的數(shù)據(jù)庫和數(shù)據(jù)處理架構(gòu)早已不堪重負(fù)。現(xiàn)代Feed流系統(tǒng)的核心是一個“混合處理引擎”:

- 流式計算(Stream Processing):像Apache Flink、Apache Kafka Streams這樣的技術(shù),扮演著“神經(jīng)中樞”的角色。它們能夠?qū)υ丛床粩喈a(chǎn)生的用戶行為數(shù)據(jù)(如點贊、評論、滑動)進行毫秒級的實時處理。例如,當(dāng)你剛剛看完一個寵物視頻,系統(tǒng)幾乎能立刻在接下來的推薦中插入更多相關(guān)萌寵內(nèi)容。這種實時性確保了Feed的“新鮮度”和響應(yīng)速度。

- 批處理(Batch Processing):對于不要求極致實時但計算復(fù)雜的數(shù)據(jù)(如深度學(xué)習(xí)模型訓(xùn)練、用戶長期興趣畫像更新),則采用如Apache Spark、Hadoop等批處理框架在后臺安靜運行。它們通常在夜間或流量低谷期,對全天海量數(shù)據(jù)進行挖掘和分析,生成更精準(zhǔn)的用戶模型和內(nèi)容標(biāo)簽。

流與批的協(xié)同,如同汽車的“渦輪增壓”與“自然吸氣”結(jié)合,既保證了瞬間的爆發(fā)力(實時推薦),也維持了持久的動力(精準(zhǔn)模型)。

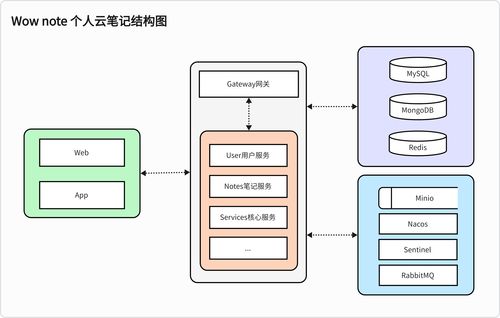

二、存儲體系的“三駕馬車”:分層、異構(gòu)與極致擴展

Feed流數(shù)據(jù)不僅量大,而且類型復(fù)雜:有需要永久存儲的用戶關(guān)系、內(nèi)容本身(冷數(shù)據(jù)),有需要快速訪問的熱門內(nèi)容和個人狀態(tài)(熱數(shù)據(jù)),還有需要頻繁更新的計數(shù)(如點贊數(shù))。因此,單一的數(shù)據(jù)庫無法勝任。當(dāng)前主流的方案是分層、異構(gòu)的存儲架構(gòu):

- 對象存儲/分布式文件系統(tǒng):用于存儲海量的原始媒體文件(圖片、視頻)和冷備份數(shù)據(jù),如阿里云OSS、AWS S3或自研的類似系統(tǒng)。它們成本低廉,擴展性幾乎無限,是系統(tǒng)的“資料庫”。

- NoSQL數(shù)據(jù)庫:這是支撐高并發(fā)讀寫的“主戰(zhàn)場”。

- 寬列數(shù)據(jù)庫(如Cassandra、HBase):擅長存儲超大規(guī)模的結(jié)構(gòu)化數(shù)據(jù)(如用戶時間線——某個用戶應(yīng)該看到的所有Feed ID列表),具備極佳的水平擴展能力,可以輕松通過增加節(jié)點來應(yīng)對用戶增長。

- 鍵值數(shù)據(jù)庫(如Redis、Aerospike):作為內(nèi)存數(shù)據(jù)庫,它們提供微秒級的讀寫速度,用于緩存最熱門的Feed內(nèi)容、用戶會話狀態(tài)以及各種計數(shù)器(閱讀數(shù)、點贊數(shù)),是保障流暢體驗的“高速緩存”。

- 搜索引擎/向量數(shù)據(jù)庫:為了滿足復(fù)雜的多維度和語義檢索(如“查找上周所有關(guān)于人工智能的科技文章”),以及新興的基于向量嵌入的相似內(nèi)容推薦,Elasticsearch、Milvus等專用存儲引擎被集成進來,實現(xiàn)內(nèi)容的深度理解和關(guān)聯(lián)。

三、智能分發(fā)的“決策大腦”:AI與算法工程的深度集成

“刷”得停不下來,很大程度上歸功于精準(zhǔn)的推薦算法。但這不僅僅是算法模型本身的優(yōu)劣,更依賴于強大的工程化支持:

- 在線學(xué)習(xí)與實時特征:系統(tǒng)能夠?qū)崟r收集用戶的反饋(停留時長、是否跳過),并快速調(diào)整對該用戶的推薦策略。特征工程也高度實時化,將“用戶剛剛搜索了滑雪”這樣的即時信號迅速納入推薦考量。

- 大規(guī)模模型部署與推理:支撐億級用戶的推薦模型往往參數(shù)巨大,且需要每秒進行數(shù)千萬次推理。這依賴于高性能的模型服務(wù)框架(如TensorFlow Serving、TorchServe)和專用的AI加速硬件(如GPU、NPU),在保證精度的將一次推薦的耗時壓縮到幾十毫秒以內(nèi)。

- 多目標(biāo)權(quán)衡與探索:Feed流不僅要考慮點擊率,還要兼顧內(nèi)容多樣性、新穎性、社會價值等多重目標(biāo)。強大的算法平臺能夠進行A/B測試、多臂老虎機等在線實驗,動態(tài)平衡這些目標(biāo),避免信息繭房。

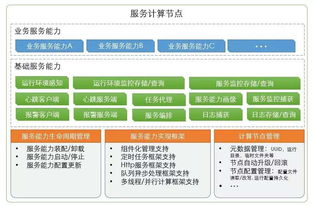

四、保障一切平穩(wěn)運行的“隱形鎧甲”:云原生與彈性伸縮

面對突發(fā)熱點事件帶來的流量洪峰(如重大新聞、明星八卦),系統(tǒng)必須具備“金剛不壞之身”。這得益于云原生技術(shù)的普及:

- 微服務(wù)架構(gòu):將龐大的Feed流系統(tǒng)拆解成用戶服務(wù)、內(nèi)容服務(wù)、推薦服務(wù)、消息推送服務(wù)等數(shù)十甚至上百個獨立的小服務(wù)。每個服務(wù)可以獨立開發(fā)、部署和擴展,故障也被隔離,不會導(dǎo)致全網(wǎng)崩潰。

- 容器化與編排:以Docker和Kubernetes為代表,服務(wù)被打包在輕量級容器中,由K8s自動管理調(diào)度。當(dāng)系統(tǒng)監(jiān)測到某個服務(wù)負(fù)載升高時,可以自動在幾秒鐘內(nèi)“克隆”出新的實例分擔(dān)壓力,實現(xiàn)真正的彈性伸縮。

- 服務(wù)網(wǎng)格與可觀測性:通過Istio等服務(wù)網(wǎng)格技術(shù),精細控制服務(wù)間的通信流量,實現(xiàn)灰度發(fā)布和故障熔斷。配合全鏈路的監(jiān)控、日志和追蹤系統(tǒng)(如Prometheus、Jaeger),工程師能像看儀表盤一樣洞察整個系統(tǒng)的健康狀態(tài)。

支撐億級用戶“刷手機”的Feed流,早已不是簡單的信息列表展示。它是一個集大規(guī)模實時數(shù)據(jù)計算、異構(gòu)數(shù)據(jù)存儲、人工智能決策與云原生彈性架構(gòu)于一體的復(fù)雜技術(shù)生態(tài)系統(tǒng)。每一次順暢的滑動背后,都是這些“新技術(shù)裝備”在無聲處進行的億萬次協(xié)同計算與調(diào)度。它們不僅代表了當(dāng)今互聯(lián)網(wǎng)信息處理與存儲技術(shù)的最高水準(zhǔn),也持續(xù)定義著我們感知世界的方式與效率。技術(shù)仍在進化,未來的Feed流或許會更智能、更沉浸、更懂你,而其背后的“裝備競賽”,也必將愈演愈烈。

如若轉(zhuǎn)載,請注明出處:http://www.zjdongya.cn/product/43.html

更新時間:2026-02-18 02:09:11